AI人臉辨識系統即時量測生理資訊

作者

楊明德簡介

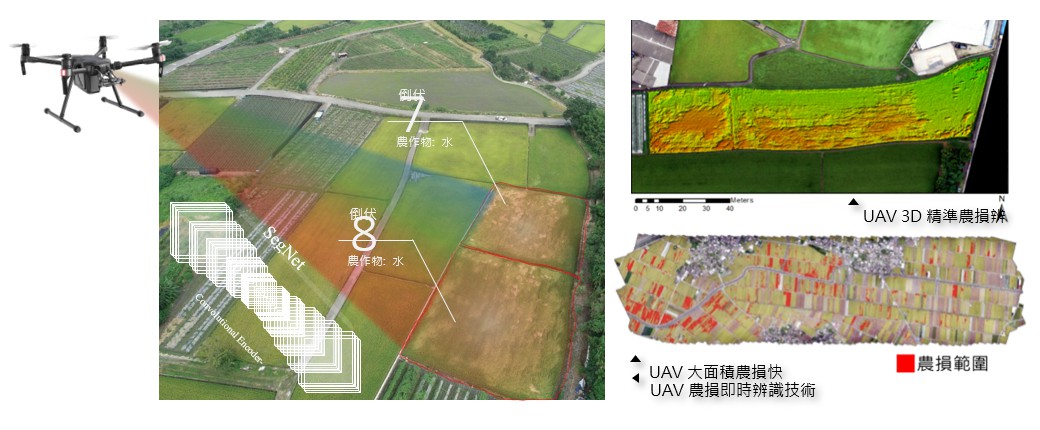

楊明德特聘教授現任中興大學土木工程學系特聘教授兼系主任、無人載具研究中心主任,積極發展AI技術於無人機影像辨識,應用於3D建模、農漁業監測與災損評估等。2019年以「無人機之農損即時辨識技術」榮獲科技部「未來科技突破獎」與「最佳人氣技術獎」及AI創新研究專案之票選「AI投資潛力獎」第三名,2020年以「陸空協作之水稻最佳收獲模式」再度榮獲科技部「未來科技突破獎」與「最佳人氣技術獎」。

單位

中興大學文章來源

https://doi.org/10.3390/rs12040633-

標籤

-

分享文章

基於國際授權條款4.0,您可免費分享此篇文章

近年快速發展的無人飛行載具(Unmanned Aerial Vehicle, UAV)有低成本、高機動性的優勢,故其普及率與應用性也快速增加,惟無人飛行載具取得之大量影像也需利用新的影像處理方式才能有效完成分析。本研究介紹如何利用深度學習方法快速處理大量UAV影像,以提供及時精確的大規模農業災損調查量化數據,進一步作為農業災害救助和農業保險的基礎。本研究建立二神經網絡體系結構的影像語義分割模型(FCN-AlexNet和SegNet),應用於UAV影像以估算大面積稻作倒伏比例,並比較其辨識準確度和計算效率。利用一組2017年UAV影像進行水稻倒伏辨識模型之訓練和測試,並驗證於2019年另一組UAV影像。其中,FCN-AlexNet的辨識成果較佳,其測試F1-score為0.82、準確度為0.93,與傳統最大概似分類法相比,本研究所提出語義分割網絡模型具有更高的效率以及較低的錯誤率,未來可將此水稻倒伏辨識模型配置於多台平行運算電腦,以應付大規模的農業災害調查。

近數十年來遙測技術快速發展,其中無人飛行載具(Unmanned Aerial Vehicle, UAV)有低成本、高機動性的優勢,其普及率與應用性於近幾年也正快速增加,例如應用於災害影響評估及地表變遷偵測。現今農業損害評估很大程度上依靠人工評估,既耗時、費力、主觀,存在效率性和客觀性不佳的問題。一具有良好空間與時間高解析度的無人機影像可以全面覆蓋受災農田,並具有相當經濟價值,可能是農業損失評估的一前瞻方法。然而,無人飛行載具取得之大量影像無法以傳統的監督式分類處理,需利用新的影像處理方式才能有效完成分析。

本研究介紹如何利用深度學習方法快速處理大量UAV影像,以提供及時精確的大規模農業災損調查量化數據,進一步作為農業災害救助和農業保險的基礎。本研究建立兩種神經網路體系結構(FCN-AlexNet和SegNet)的影像語義分割模型,應用於UAV影像以估算大面積稻作倒伏比例,並比較其辨識準確度和計算效率。基於AlexNet架構,FCN-AlexNet具有更深層的網路優勢,並用1X1卷積層和63X63上採樣層取代了AlexNet的完全連接層,以完成逐像素的端到端語義分割。此外,FCN可以接受任何大小的輸入影像,並將像素空間訊息保留在原始輸入影像中,從而可對特徵圖上的每個像素進行分類。SegNet具有非對稱網路結構,包括由卷積層和池化層組成的編碼器、由上採樣層和卷積層組成的解碼器、而後是softmax層。編碼器結構與VGG16網路中的13個卷積層相同,但沒有完全連接層。在編碼器之後,解碼器具有與編碼器對稱的結構,但是採用上採樣層替代轉置卷積。下一步為應用這兩個影像語義分割模型於多時期無人機影像,辨識大規模水稻倒伏稻田並估計每塊稻田的倒伏比例。本研究利用一組2017年UAV影像進行水稻倒伏辨識模型之訓練和測試,並驗證於2019年另一組UAV稻田影像。其中,FCN-AlexNet的測試F1-score為0.82、準確度為0.93,AlexNet的測試F1-score為0.79、準確度為0.92。

相較於傳統最大概似分類法之辨識成果,本研究所提出語義分割網絡模型具有更高的效率(約10至15倍的速度)以及較低的錯誤率,所產製之水稻倒伏主題圖可提供農業損失評估及緊急救助之準確且定量參考。未來可將此水稻倒伏辨識模型配置於多台平行電腦同步運算,以應付大規模的農業災害調查。更進一步將配微型電腦配備於無人機,使之具深度學習模型之邊緣計算能力,可讓無人機有簡化之影像處理功能,因應帶辨識目標調整飛行任務,提供即時農業災害調查。

延伸閱讀-科技部(科技大觀園)

訂閱電子報以獲得最新資訊

填寫連絡資訊以取得每月發行之電子報